不止 Sora2!拍我AI V5.5 更新:人人都能用 AI 视频当导演了

不止 Sora2!拍我AI V5.5 更新:人人都能用 AI 视频当导演了2025 年,AI 视频又把桌子掀了。手切金属、小猫做饭,甚至是那个火遍全网的「奥特曼宇宙」,对 AI 来说不过是几句 Prompt 的功夫。

2025 年,AI 视频又把桌子掀了。手切金属、小猫做饭,甚至是那个火遍全网的「奥特曼宇宙」,对 AI 来说不过是几句 Prompt 的功夫。

无需额外训练即可适配预训练生成模型的编辑方法,凭借灵活、高效的特性,已成为视觉生成领域的研究热点。这类方法通过操控 Attention 机制(如 Prompt-to-Prompt、MasaCtrl)实现文本引导编辑,但当前技术存在两大核心痛点,严重限制其在复杂场景的应用

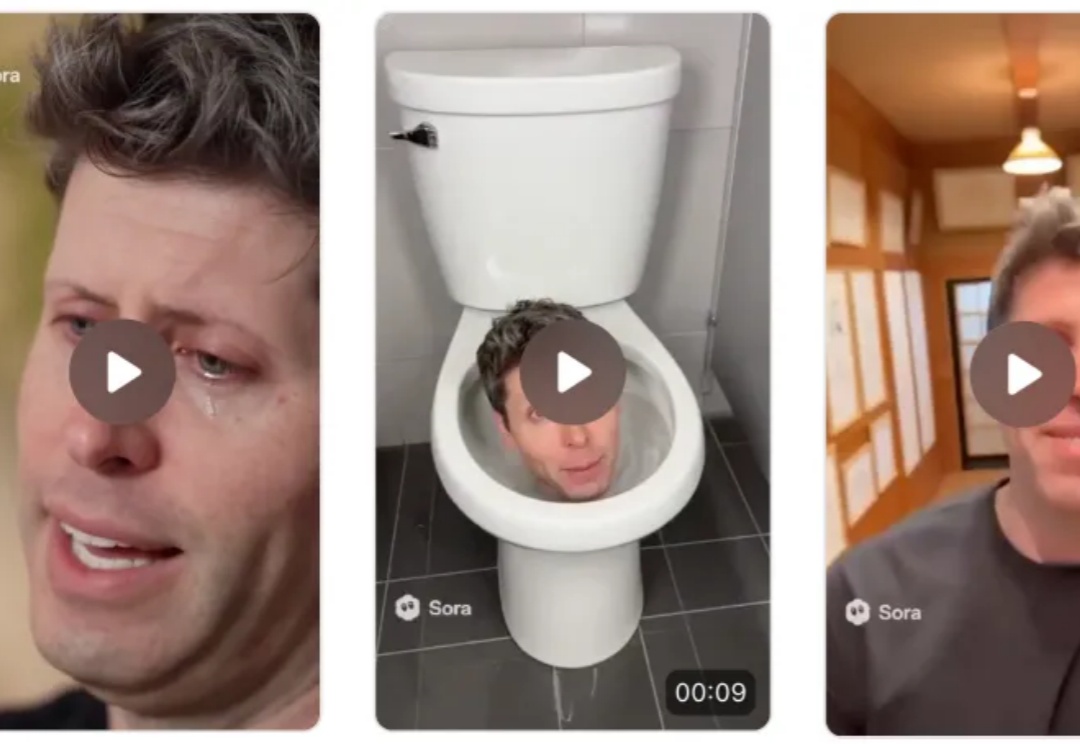

十月,《纽约时报》发表了题为《The A.I. Prompt That Could End the World》(《那个可能终结世界的 AI 提示词》)的文章。作者 Stephen Witt 采访了多位业内人士:有 AI 先驱,图灵奖获奖者 Yoshua Bengio;以越狱测试著称的 Leonard Tang;以及专门研究模型欺骗的 Marius Hobbhahn。

![苹果盯上Prompt AI, 不是买产品,是要伯克利团队的[视觉大脑]](https://www.aitntnews.com/pictures/2025/10/15/ca7bf835-a97f-11f0-88f9-fa163e47d677.jpg)

根据外媒 CNBC 消息,苹果公司正和计算机视觉领域的初创企业 Prompt AI,推进收购事宜的 “最后阶段谈判”。

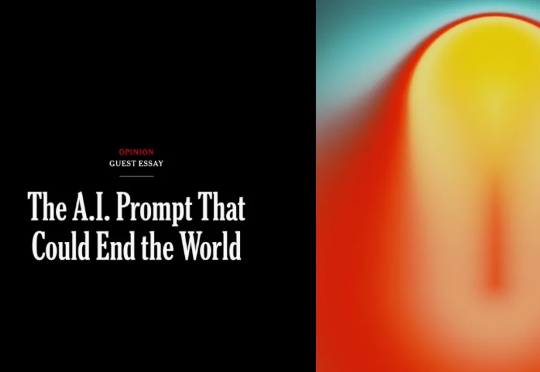

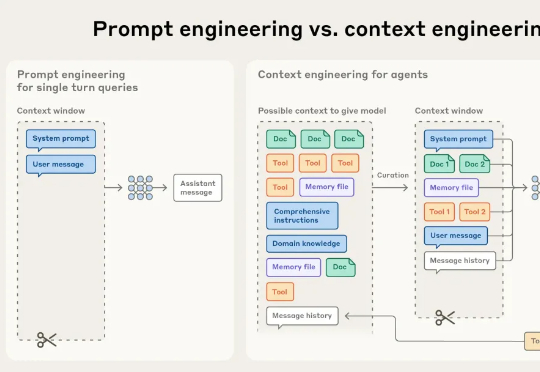

Hi,返工早上好。 我是洛小山,和你聊聊 AI 行业思考。 AI Agent 应用的竞争逻辑,正在发生根本性变化。 当许多团队还在死磕提示词优化(PE 工程)时,一些优秀团队开始重心转向了上下文工程

MT Park 的第12场AI分享会顺利进行!~🎉 感谢向阳乔木老师非常细致地分享了: 他探索 Prompt 的多场景实践,从 Cursor、Windsurf 等 vibe 编程工具,到 Veo3 的视频生成,覆盖编程、教育、内容创作等多个方向,带你快速上手 AI 最实用的玩法。

今年上半年,最吊足胃口和期待的,莫过于 Agent 工具,饼画得都很大:日常中那些烧脑、重复、耗时间的任务,现在似乎只需要动动手指、敲几行 prompt 就能搞定。

在计算机科学领域,有一句英文谚语——「Garbage in, Garbage out」。

昨天YC一个访谈《State-Of-The-Art Prompting For AI Agents》,专门讲他们投资的一家客服公司,公开了他们提示词的写法,这应该也属于第一家吧。

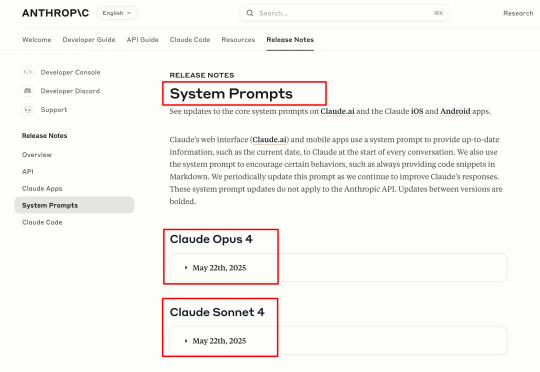

时隔 3 个月,Anthropic 上新了 Claude 4 模型。并同步了 Claude 4 Opus 和 Sonnet 两个模型的最新系统提示词。(Opus 是旗舰版、Sonnet 是主力版)经过对照,Claude 4 Opus 与 Sonnet 版本的系统提示词,基本没有区别,所以只需要看 Opus 的提示词即可: